Small Language Models im LegalTech: Teil 1 – SLM vs. LLM

Was sind Small Language Models (SLMs)?

Small Language Models (SLMs) sind kompakte KI-Sprachmodelle, die Text mit weit weniger Rechenressourcen verarbeiten und generieren als die riesigen Modelle hinter Tools wie ChatGPT.

In der Praxis arbeiten SLMs typischerweise mit weniger als 30 Milliarden Parametern, während große Sprachmodelle (LLMs) wie GPT-4 Hunderte von Milliarden haben können. Durch ihre geringere Größe konzentrieren sich SLMs auf spezifische Aufgaben oder Domänen – zum Beispiel die Analyse juristischer Dokumente – statt die gesamte Breite menschlichen Wissens abzudecken.

Dieser fokussierte Ansatz bedeutet, dass SLMs oft hohe Effizienz und Geschwindigkeit erreichen und dabei eine starke Leistung bei ihren vorgesehenen Aufgaben beibehalten. Entwickler trainieren SLMs häufig mit sorgfältig kuratierten, domänenspezifischen Daten (wie juristischen Texten) anstatt mit den riesigen, vielfältigen Datensätzen, die für LLMs verwendet werden. Diese Spezialisierung ermöglicht es ihnen, in Nischenanwendungen mit schnelleren Antworten und geringerem Ressourcenbedarf zu glänzen – das macht sie besonders attraktiv für den Rechtsbereich.

Zusammengefasst ist ein SLM ein schlankes Sprachmodell, das auf Effizienz optimiert ist – für einen umfassenden Vergleich verschiedener KI-Modelle lies unseren Artikel Welche KI-Modelle sollte ich verwenden?. Im juristischen Kontext ermöglicht es schnelles Arbeiten, den Betrieb vor Ort und gezieltes Fachwissen – ein deutlicher Kontrast zu den cloud-abhängigen Großmodellen, die als Allzweck-LLMs dienen.

Dieser Artikel ist Teil einer mehrteiligen Serie, die sich der Einführung von Small Language Models (SLMs) und ihrem wachsenden Einfluss auf Legal Technology widmet. In dieser Serie tauchen wir in die wesentlichen Aspekte von SLMs für Juristinnen und Juristen ein – und erkunden ihre Vorteile, Einschränkungen, Best Practices und realen Anwendungen für Kanzleien und Rechtsabteilungen.

In diesem ersten Teil behandeln wir die Grundlagen:

- Was sind Small Language Models (SLMs)?

- Wie unterscheiden sich SLMs von Large Language Models (LLMs)?

- Warum werden SLMs zum Game Changer im Rechtsbereich?

Jede kommende Folge wird sich auf ein bestimmtes Thema rund um SLMs konzentrieren und dir vertiefte Einblicke geben, um fundierte Entscheidungen über den Einsatz von KI in deiner Rechtspraxis zu treffen. Bleib dran für weitere praktische Anleitungen und Fallstudien in den kommenden Wochen.

Zentrale Unterschiede: Small Language Models (SLMs) vs. Large Language Models (LLMs)

Sowohl SLMs als auch LLMs sind KI-Modelle, die menschliche Sprache generieren und interpretieren, aber es gibt entscheidende Unterschiede in Größe, Fokus und Praxistauglichkeit:

Die wichtigsten Unterschiede:

- Größe und Parameter: SLMs sind bewusst „klein” – meist im Bereich von Millionen bis niedrigen zweistelligen Milliarden Parametern – während LLMs Hunderte von Milliarden oder sogar Billionen aufweisen. Ein SLM könnte beispielsweise 7 Milliarden Parameter für die Verarbeitung juristischer Texte haben, während GPT-4 (ein LLM) ein wesentlich größeres Netzwerk nutzt – mehr dazu in unserem Vergleich von GPT-1 bis GPT-4. Diese schlanke Größe macht SLMs leichter und schneller.

- Spezialisierung vs. Generalisierung: SLMs werden typischerweise mit kuratierten, domänenspezifischen Daten trainiert, was sie zu Experten in einer Nische macht (z. B. Vertragssprache, DSGVO-Regelungen). LLMs werden dagegen mit Daten im Internet-Maßstab trainiert, was sie zu Generalisten macht, die ein breites Spektrum an Fragen beantworten können – allerdings nicht immer mit domänenspezifischer Tiefe. In der Praxis könnte ein SLM eine komplexe Vertragsklausel zuverlässiger interpretieren, während ein LLM über viele Themen (juristische und nicht-juristische) ein wenig weiß.

- Geschwindigkeit und Effizienz: SLMs bieten schnellere Antwortzeiten (Millisekunden) und verbrauchen weit weniger Speicher und Energie. LLMs sind größer und können langsamer sein – manchmal dauert die Antwort Sekunden oder länger – und verbrauchen deutlich mehr Rechenleistung pro Anfrage. Der Unterschied lässt sich mit einem Kleinwagen im Vergleich zu einem schweren Lkw vergleichen: Der eine beschleunigt schnell und passt in kleine Lücken (SLM), der andere transportiert mehr, aber zu höheren Kosten und mit langsamerer Manövrierfähigkeit.

- Kosten und Zugänglichkeit: SLMs sind günstiger in Training und Betrieb. Das Training eines SLMs auf einem juristischen Datensatz könnte im Bereich von Tausenden Euro kosten, während ein hochmodernes LLM Millionen in der Entwicklung verschlingen kann. Für Kanzleien oder Rechtsabteilungen bringen SLMs KI in Reichweite – ohne die hohen Pay-per-Use-API-Gebühren, die oft mit großen Drittanbietermodellen einhergehen. Auch der Energieverbrauch ist bei SLMs deutlich geringer, was mit den Kosteneinsparungs- und Nachhaltigkeitszielen von Kanzleien übereinstimmt.

- Datenschutz und Compliance: Der vielleicht wichtigste Punkt für juristische Anwendungen: SLMs können hinter der Firewall einer Kanzlei betrieben werden, sodass sensible Daten im Haus bleiben. Große Cloud-LLMs senden Daten typischerweise zur Verarbeitung an externe Server, was Bedenken hinsichtlich Mandantenvertraulichkeit und Datenschutz aufwirft. SLMs ermöglichen es Kanzleien dagegen, die vollständige Kontrolle über ihre Daten zu behalten, da die Modelle lokal laufen können. Dieser entscheidende Unterschied bedeutet, dass SLMs strenge Datenschutzanforderungen wie die DSGVO leichter erfüllen können, da keine personenbezogenen Daten die Server der Organisation verlassen müssen.

Ideale Anwendungsbereiche unterscheiden sich für SLMs und LLMs

Es ist wichtig zu beachten, dass diese Unterschiede auch bedeuten, dass SLMs und LLMs jeweils ihre idealen Einsatzbereiche haben. LLMs haben weiterhin einen Vorteil bei sehr breiten oder komplexen sprachlichen Aufgaben (dank ihres enormen Trainingsumfangs), während SLMs für spezialisierte, sichere und schnelle Anwendungen glänzen. Wie es eine Analyse formulierte: Teams sollten „SLMs wählen, wenn der Anwendungsfall spezialisierte Leistung, lokale Bereitstellung oder vollständige Kontrolle über die Daten erfordert” – und sich nur dann für Cloud-LLMs entscheiden, wenn breite, vielseitige Intelligenz ohne strenge Datenschutz- oder Latenzanforderungen benötigt wird.

Warum liegen Small Language Models (SLMs) im LegalTech-Bereich im Trend?

Datenschutz und Datensicherheit sind eine treibende Kraft hinter dem SLM-Boom in der Rechtsbranche.

Kanzleien und Rechtsabteilungen verwalten große Mengen vertraulicher Mandanteninformationen, und viele sind verständlicherweise zurückhaltend, diese Daten an cloudbasierte KI-Dienste zu senden.

Tatsächlich ergab eine Thomson-Reuters-Umfrage von 2023, dass eine erhebliche Anzahl von Kanzleien die Nutzung von Tools wie ChatGPT eingeschränkt oder verboten hat, wobei Anwälte angaben, dass sie „dem öffentlich zugänglichen ChatGPT … nicht vollständig mit vertraulichen Mandantendaten vertrauen”.

Dieses Misstrauen gegenüber großen Cloud-KI-Systemen, gepaart mit strengen Regelungen wie der DSGVO, hat eine Nachfrage nach KI-Lösungen geschaffen, die Daten vor Ort belassen. SLMs erfüllen dieses Bedürfnis, indem sie es Rechtsteams ermöglichen, KI-Modelle hinter ihrer eigenen Firewall oder in einer privaten Cloud zu betreiben und sicherzustellen, dass sensible Daten (wie Vertragsentwürfe oder Fallakten) niemals ihre Kontrolle verlassen.

Europäische Regulierungsbehörden haben diesen Vorteil sogar hervorgehoben: Der Europäische Datenschutzausschuss stellte fest, dass die lokale Nutzung von SLMs den Datenschutz verbessern kann, indem die Abhängigkeit von zentralisierten LLMs reduziert wird – ein klares Signal für die Eignung der Technologie zur DSGVO-Konformität.

Erschwinglichkeit und Zugänglichkeit sind ein weiterer Grund, warum SLMs im LegalTech an Bedeutung gewinnen.

Traditionelle große KI-Modelle bringen oft Pay-per-Use-Gebühren oder teure Infrastrukturanforderungen mit sich, die kleine und mittelgroße Kanzleien als prohibitiv empfinden. Im Gegensatz dazu sind SLMs kosteneffizient – sowohl in der Bereitstellung als auch im Betrieb – und bringen fortschrittliche KI-Fähigkeiten in Reichweite von Kanzleien, die kein Silicon-Valley-großes Technik-Budget haben.

Beispielsweise können viele Kanzleien ein Open-Source-Modell mit 7 Milliarden Parametern für die juristische Dokumentenprüfung auf Standard-Hardware betreiben, die sie bereits besitzen – zu einem Bruchteil der Kosten eines massiven API-basierten Modells. Diese niedrigere Einstiegshürde bedeutet, dass selbst Boutique-Kanzleien oder Einzelanwälte mit KI-gestützter juristischer Textarbeit oder Recherchetools experimentieren können. Dadurch demokratisieren SLMs die juristische KI und ermöglichen eine breitere Adoption in der gesamten Branche.

Anpassungsfähigkeit und Kontrolle über die Wissensbasis der KI machen SLMs ebenfalls attraktiv.

Juristische Arbeit umfasst oft hochspezifische Bereiche (z. B. See-Versicherungsrecht oder interne Richtlinien eines Unternehmens), die generische Modelle möglicherweise nicht gut erfassen.

Eine Kanzlei kann SLMs auf ihrem eigenen Dokumentenkorpus feinabstimmen – ob vergangene Schriftsätze, Vertragsvorlagen oder regulatorische Einreichungen – um ein Modell zu erhalten, das die Sprache der Kanzlei spricht. Dieses gezielte Training kann auf einem kleinen Modell schnell genauere und relevantere Ergebnisse für diese Nischenaufgaben liefern.

Juristinnen und Juristen schätzen, dass ein auf ihre Bedürfnisse abgestimmtes SLM beispielsweise die bevorzugte Klauselsprache aus ihrer eigenen Vertragsbibliothek verwendet und weniger wahrscheinlich irrelevante oder falsche Zitate „halluziniert”. Anders gesagt: Fokus schafft Zuverlässigkeit. Ein LegalTech-Anbieter betont, dass im Recht „Genauigkeit mindestens genauso wichtig ist wie Skalierung, wenn nicht sogar wichtiger”, und kleinere spezialisierte Modelle viele der Fallstricke (wie sachliche Fehler) vermeiden, die ihre größeren Gegenstücke plagen.

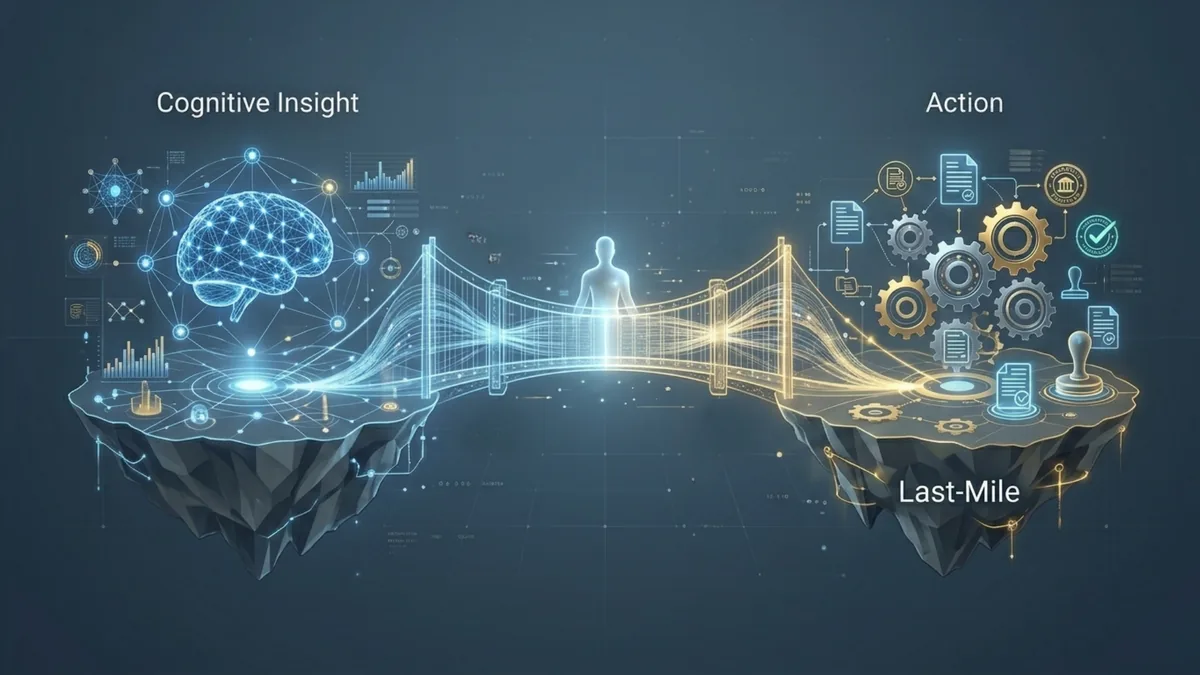

Schließlich liegen SLMs im Trend wegen ihrer schnellen Leistung und nahtlosen Integration in juristische Workflows.

Diese Modelle können Antworten mit nahezu null Latenz liefern, was bei zeitkritischen juristischen Aufgaben wie Vertragsverhandlungen oder Gerichtseinreichungen entscheidend ist.

Ein Branchenexperte stellte fest, dass SLMs mittlerweile an „Big-Law-Rechercheleistung” heranreichen – das heißt, sie können juristische Informationen fast so effektiv durchsuchen und analysieren wie Top-Anwälte – aber zu „minimalen Kosten und nahezu null Latenz”.

Ob ein Associate eine schnelle Zusammenfassung eines 100-seitigen Vertrags benötigt oder ein Syndikusanwalt eine Compliance-Checkliste durchgeht – SLMs liefern Ergebnisse im Handumdrehen. Darüber hinaus können sie in vertraute Tools (wie Microsoft Word oder Dokumentenmanagementsysteme) integriert werden, oft über On-Premises-Plugins, sodass du KI-Unterstützung nutzen kannst, ohne die Plattform zu wechseln oder Kompromisse bei der Datensicherheit einzugehen.

Die Kombination aus Mandantenvertraulichkeit, Kosteneffizienz und maßgeschneiderter Geschwindigkeit erklärt, warum SLMs zu einem der heißesten LegalTech-Trends geworden sind – insbesondere in Europa, wo Datensouveränität von größter Bedeutung ist.

Bereit, deine rechtlichen Workflows zu automatisieren?

Entdecke, wie e! deine rechtlichen Abläufe mit No-Code-Automatisierung transformieren kann.