KI-Deepfakes & rechtliche Herausforderungen | Lexemo Blog

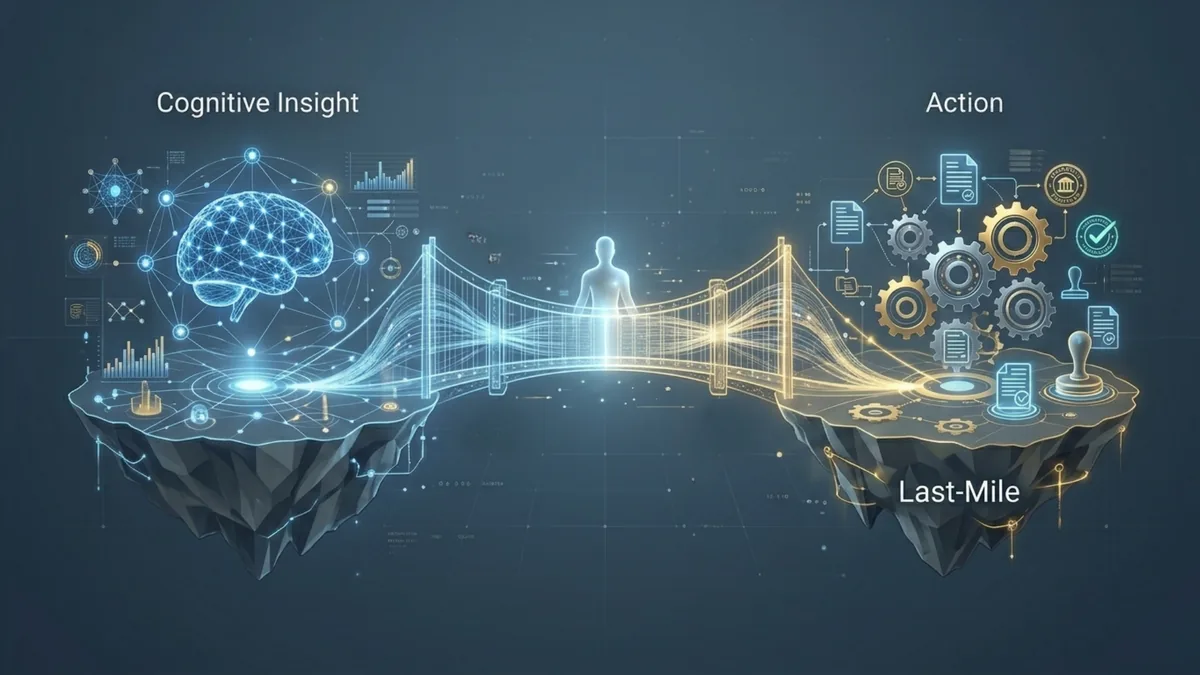

Der Aufstieg KI-generierter Deepfakes stellt die Integrität von Gerichtsverfahren vor erhebliche Herausforderungen, da diese Technologien hyperrealistische, aber gefälschte Inhalte erzeugen können, die das Vertrauen in Beweismittel untergraben. Um dieses Problem zu bewältigen, brauchst du einen umfassenden Ansatz, der rechtliche Rahmenbedingungen, Erkennungstechnologien und Durchsetzungsmechanismen umfasst. Rechtsexperten und Technologiespezialisten müssen zusammenarbeiten, um Standards für die Erkennung manipulierter Medien zu entwickeln, während Gesetzgeber die Lücken schließen müssen, die diese Technologien aufdecken.

In diesem Artikel betrachten wir die bestehenden Probleme und die Methoden, die diese Herausforderungen im Rechtssystem potenziell kontrollieren können.

Der bestehende rechtliche Rahmen und seine Auswirkungen auf Deepfakes

Die Rechtslandschaft rund um Deepfakes entwickelt sich weiter. Derzeit gibt es keine umfassende Gesetzgebung, die sich speziell mit Deepfakes befasst. Allerdings haben einige US-Bundesstaaten begonnen, Gesetze gegen nicht-einvernehmliche sexuell explizite Deepfakes und deren Einsatz bei Wahlmanipulation umzusetzen. Beispielsweise hat die Federal Communications Commission kürzlich den Einsatz KI-generierter Stimmen in unaufgeforderten Robocalls für illegal erklärt, was den Bedarf an Regulierung in diesem Bereich unterstreicht.

Die bestehenden rechtlichen Rahmenbedingungen wie Datenschutzgesetze, Urheberrechtsgesetze und Verleumdungsstatuten können auf bestimmte Aspekte der Deepfake-Technologie angewendet werden. Diese Gesetze greifen jedoch oft zu kurz, wenn es um die breiteren Auswirkungen von Deepfakes geht, insbesondere im Kontext von Desinformation und Wahlintegrität.

Es gibt Forderungen nach neuer Gesetzgebung, die speziell auf die Erstellung und Verbreitung von Deepfakes abzielt. Der Vorschlag der Europäischen Union zum KI-Gesetz enthält Bestimmungen, die Nutzer von KI-Systemen, die Deepfake-Inhalte erzeugen, zur Offenlegung der künstlichen Natur verpflichten, um Transparenz und Rechenschaftspflicht zu verbessern.

Ein erhebliches Hindernis für eine wirksame Regulierung ist die Durchsetzung bestehender Gesetze. Viele Rechtsvorschriften zur Bekämpfung von Betrug und Täuschung sind bereits vorhanden, aber die schiere Menge an manipulierten Inhalten erschwert die Durchsetzung. Berichte zeigen, dass die Durchsetzung von Gesetzen zu Deepfakes oft unzureichend ist, was zu einer Verbreitung schädlicher Inhalte ohne ausreichenden Rechtsschutz führt.

Notwendigkeit der Entwicklung von Deepfake-Erkennungsstandards

Experten betonen die Notwendigkeit, robuste Erkennungsstandards für Deepfakes zu entwickeln. Dazu gehören sowohl manuelle als auch automatisierte Erkennungsmethoden zur Überprüfung der Authentizität digitaler Beweismittel. Strafverfolgungsbehörden werden aufgefordert, neue Technologien und Schulungen einzuführen, um mit den sich schnell weiterentwickelnden Fähigkeiten der Deepfake-Technologie Schritt zu halten.

Die Entwicklung zuverlässiger Erkennungstechnologien ist entscheidend für die Identifizierung von Deepfakes. Aktuelle Methoden umfassen sowohl manuelle Überprüfungen durch Experten als auch automatisierte Systeme, die Machine-Learning-Algorithmen nutzen, um Inkonsistenzen in Video- und Audioinhalten zu erkennen. Diese Technologien müssen sich schnell weiterentwickeln, um mit den Fortschritten bei der Deepfake-Erzeugung Schritt zu halten.

Partnerschaften zwischen Strafverfolgungsbehörden, Rechtsexperten und Technologieunternehmen sind entscheidend für die Entwicklung wirksamer Erkennungswerkzeuge. Unternehmen wie Google und Microsoft tragen bereits zur Forschung bei, die darauf abzielt, die Deepfake-Erkennungsfähigkeiten zu verbessern.

Die Sensibilisierung der Öffentlichkeit für Deepfakes und ihre potenziellen Auswirkungen ist von entscheidender Bedeutung. Aufklärungskampagnen können dir und der Öffentlichkeit helfen, Medieninhalte kritisch zu bewerten und potenzielle Deepfakes zu erkennen.

Gesetzgeberische Initiativen

Gesetzgeber stehen unter Druck, Gesetze zu schaffen, die den Missbrauch von Deepfakes gezielt bekämpfen. Dazu gehört der Schutz von Personen vor Verleumdung und die Sicherstellung, dass Deepfakes nicht zur Manipulation der öffentlichen Meinung oder zur Störung demokratischer Prozesse eingesetzt werden können.

Einige Experten schlagen vor, die Produktion und Verbreitung von Deepfake-Technologie für den Verbrauchergebrauch zu verbieten, insbesondere angesichts der Tatsache, dass ein hoher Prozentsatz der Deepfakes für böswillige Zwecke erstellt wird.

Die Einrichtung von Ko-Regulierungsrahmen kann helfen, die Herausforderungen durch Deepfakes zu bewältigen. Dieser Ansatz beinhaltet die Zusammenarbeit zwischen Regierungen, Technologieunternehmen und der Zivilgesellschaft, um Leitlinien und Standards für den verantwortungsvollen Einsatz von Deepfake-Technologie zu entwickeln.

Angesichts der globalen Natur des Internets ist internationale Zusammenarbeit notwendig, um die Herausforderungen durch Deepfakes zu bewältigen. Länder können vom Austausch bewährter Verfahren und der Entwicklung harmonisierter Vorschriften profitieren.

Empfehlungen zum Schutz der Justiz

Um das Justizsystem besser vor den Bedrohungen durch Deepfakes zu schützen, werden folgende Maßnahmen empfohlen:

- Klare Rechtsstandards schaffen: Umfassende Gesetze entwickeln, die speziell die Erstellung, Verbreitung und Nutzung von Deepfakes regeln.

- Erkennungstechnologien verbessern: In Forschung und Entwicklung fortschrittlicher Erkennungstechnologien investieren, die Deepfakes zuverlässig identifizieren können.

- Schulung für Strafverfolgungsbehörden: Schulungen für Strafverfolgungsbehörden und Juristen zu den Auswirkungen der Deepfake-Technologie anbieten.

- Öffentliche Aufklärungskampagnen: Die Öffentlichkeit über die Existenz und potenziellen Gefahren von Deepfakes aufklären.

- Zusammenarbeit mit Technologieunternehmen: Partnerschaften zwischen Rechtsexperten und Technologiefirmen fördern.

Durch die Umsetzung dieser Strategien können Akteure sicherstellen, dass das Justizsystem widerstandsfähig gegenüber den Herausforderungen durch KI-generierte Deepfakes bleibt. Mehr dazu in unserem Artikel zum Schutz des Justizsystems vor der Deepfake-Bedrohung.

Um das Justizsystem wirksam vor den Risiken im Zusammenhang mit Deepfakes zu schützen, ist ein vielschichtiger Ansatz erforderlich. Dazu gehören die Verbesserung der rechtlichen Rahmenbedingungen, die Weiterentwicklung der Erkennungstechnologien und die Gewährleistung robuster Durchsetzungsmechanismen. Lies auch unseren Artikel über ethische KI im Recht.

Bereit, deine rechtlichen Workflows zu automatisieren?

Entdecke, wie e! deine rechtlichen Abläufe mit No-Code-Automatisierung transformieren kann.